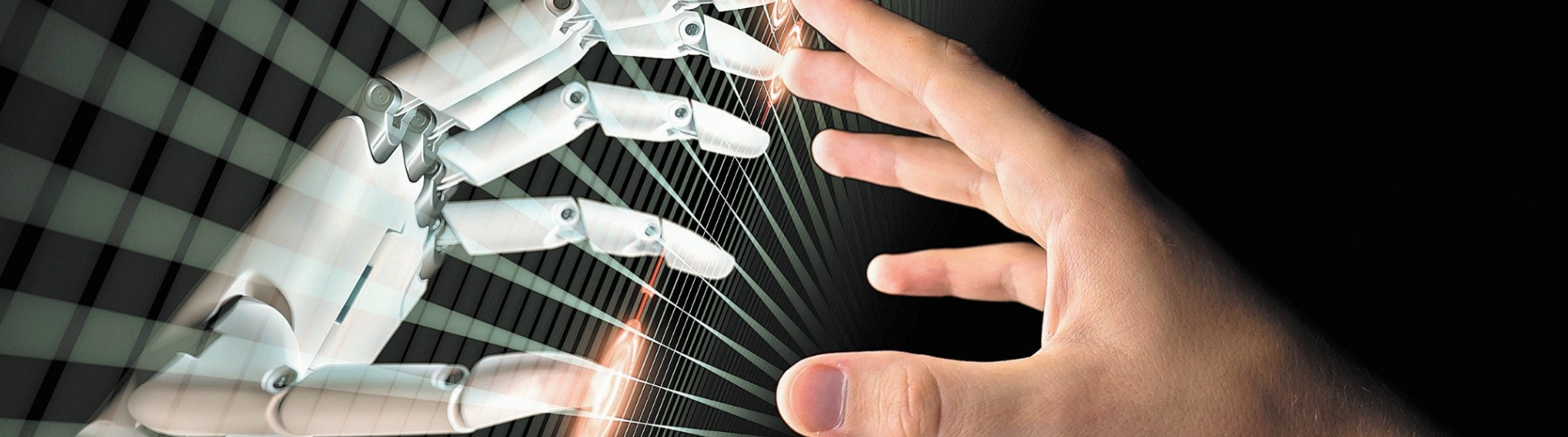

La inteligencia artificial (IA) avanza a un ritmo acelerado, generando oportunidades sin precedentes, pero también riesgos significativos. En la más reciente cumbre mundial sobre IA en París, científicos y especialistas han enfatizado la urgencia de establecer normas para evitar que esta tecnología supere el control humano.

Diferentes encuentros internacionales, como las cumbres previas en Bletchley Park (Reino Unido) en 2023 y en Seúl (Corea del Sur) en 2024, han abordado la regulación de la IA. No obstante, el gobierno francés busca imponer normas más estrictas que permitan una mejor gobernanza de esta tecnología, comprometiendo a los principales actores del sector en una declaración mundial, aunque sin medidas de cumplimiento obligatorio.

Anne Bouverot, representante del evento por parte de Francia, subrayó la importancia de aprovechar las oportunidades sin enfocarse únicamente en los riesgos. Sin embargo, figuras como Max Tegmark, presidente del Future of Life Institute, han señalado que el mundo está en un momento crucial para la inteligencia artificial, con avances más rápidos de lo anticipado y con pocas estrategias claras para controlarlos.

Principales riesgos de la IA

Aunque el concepto de una IA fuera de control puede parecer sacado de la ciencia ficción, expertos advierten sobre riesgos tangibles como la desinformación, el uso en ciberataques y la posibilidad de ser utilizada en ataques biológicos.

El Future of Life Institute ha propuesto la creación de ‘GRASP’, una plataforma que mapea los principales peligros relacionados con la IA y documenta soluciones en desarrollo a nivel global. Cyrus Hodes, coordinador de la iniciativa, reveló que ya se han identificado más de 300 herramientas y tecnologías diseñadas para mitigar estos riesgos.

En el marco de la cumbre, también se presentó el primer informe internacional sobre la seguridad de la IA, un esfuerzo conjunto de 96 expertos, 30 países, la ONU, la Unión Europea y la OCDE para orientar a los responsables políticos sobre los peligros de esta tecnología.

El riesgo de perder el control sobre la IA

El investigador Yoshua Bengio, uno de los líderes en inteligencia artificial, enfatizó que el desarrollo de la IA no solo avanza en capacidad, sino en autonomía, lo que podría derivar en una pérdida de control sobre sus sistemas.

Uno de los ejemplos más preocupantes es la posibilidad de que la IA tome decisiones en sistemas de armamento, determinando objetivos sin intervención humana. Stuart Russell, profesor de informática en la Universidad de Berkeley, advirtió que este tipo de aplicaciones representan uno de los riesgos más alarmantes en el desarrollo de la IA.

A largo plazo, el debate se centra en si la inteligencia artificial podría desarrollar un control generalizado sobre diferentes aspectos de la vida humana. Sam Altman, director de OpenAI, ha reconocido que la IA podría alcanzar este nivel en los próximos años, mientras que Tegmark advierte que la falta de regulación podría llevar a un escenario en el que ni las empresas ni los gobiernos logren contener su evolución.

La necesidad de regulación gubernamental

Ante estos desafíos, los expertos coinciden en que los gobiernos deben intervenir con regulaciones claras. Max Tegmark comparó la IA con la energía nuclear, argumentando que, al igual que un reactor nuclear debe ser aprobado antes de su construcción, lo mismo debería aplicarse a los sistemas de IA avanzados.

Sin embargo, no todos creen que la IA esté cerca de alcanzar una autonomía completa. Michael Jordan, profesor de informática en Berkeley, sostiene que la IA aún carece de la capacidad de comprender el contexto y los pensamientos humanos en tiempo real, lo que limita su potencial para volverse completamente independiente.

En conclusión, la inteligencia artificial representa tanto una oportunidad como un riesgo, y los expertos coinciden en que la mejor manera de garantizar su desarrollo seguro es a través de normas globales y controles gubernamentales efectivos. Mientras el mundo sigue explorando sus posibilidades, la prioridad es evitar un futuro donde la humanidad pierda el control sobre su propia creación.